Prospettive dell’Intelligenza Artificiale in cardiologia

🎧 Ascolta il podcast dell’articolo

🧑🎓Seguici su Youtube alla playlist Verso una nuova cardiologia

🧠 La cardiologia nell’era dell’intelligenza artificiale

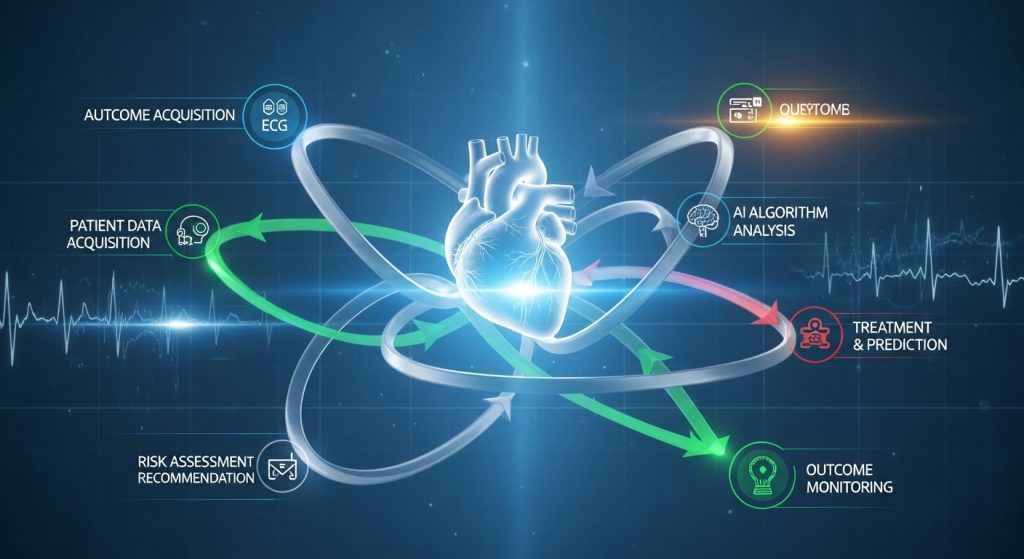

L’intelligenza artificiale (IA) sta rivoluzionando la cardiologia, ma la sua applicazione clinica è ancora limitata da sfide tecniche, etiche e regolatorie. Comprendere questi ostacoli è essenziale per un’integrazione sicura, equa e trasparente nella pratica medica quotidiana.

⚙️ Dati, bias e rappresentatività: la base su cui costruire fiducia

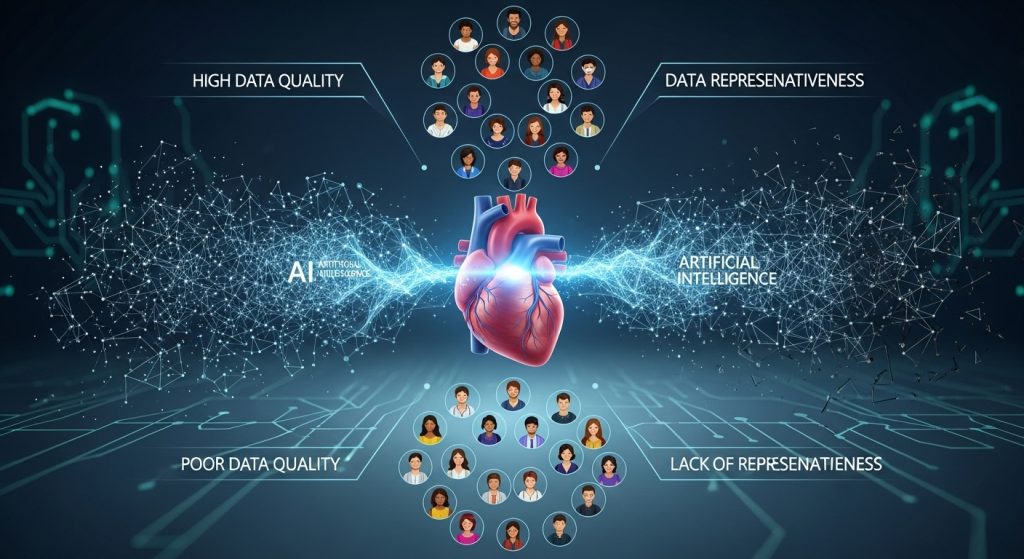

Uno dei principali ostacoli alla diffusione dell’IA in cardiologia è la qualità e la rappresentatività dei dati.

Molti modelli vengono addestrati su campioni ristretti o provenienti da un’unica area geografica, con il rischio di introdurre bias che riducono l’affidabilità dei risultati in contesti differenti.

Questo limita la generalizzabilità delle previsioni, rendendo indispensabile un’attenzione rigorosa alla diversità dei dataset di addestramento e alla validazione multicentrica.

🧠 Trasparenza e explainable AI: oltre la “scatola nera”

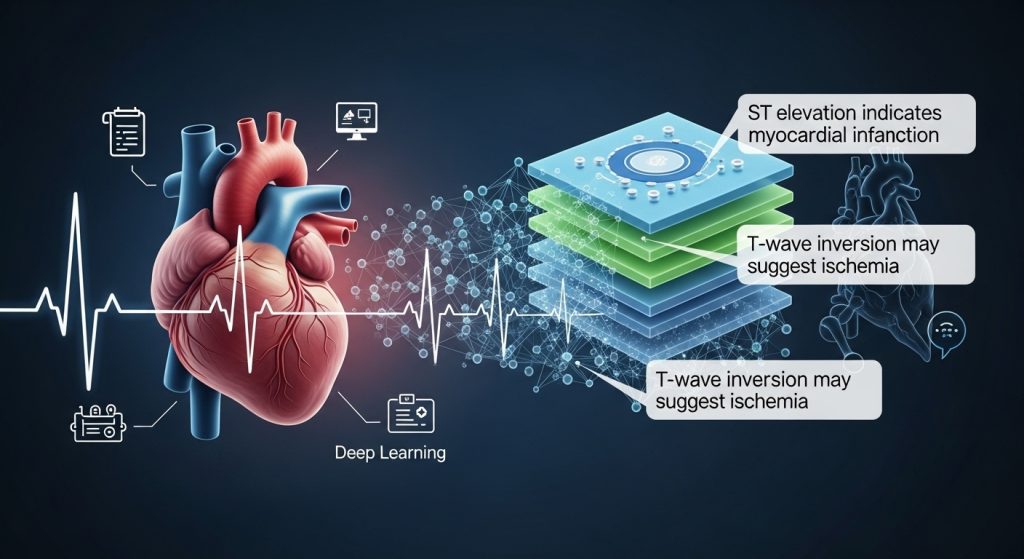

Molti sistemi di deep learning offrono risultati precisi ma difficili da interpretare, configurandosi come vere e proprie “scatole nere”.

In ambito medico, dove ogni decisione diagnostica deve essere motivata e verificabile, questa opacità rappresenta un limite etico e clinico. Il concetto di explainable AI (XAI) mira a creare algoritmi che sappiano spiegare e giustificare le proprie decisioni, requisito indispensabile per l’accettazione da parte dei medici e dei pazienti.

📖 Fonte: Enhancing Explainability of Deep Learning-Based ECG Diagnosis Using Large Language Models | Proceedings of the 2024 8th International Conference on Advances in Artificial Intelligence

🔬 Validazione clinica e prove reali: il gap tra laboratorio e corsia

Nonostante migliaia di studi preliminari, solo una trentina di trial clinici randomizzati hanno valutato l’impatto reale dell’IA sui risultati cardiovascolari.

Questo evidenzia una discrepanza tra le promesse teoriche e la convalida clinica: molte soluzioni si fermano allo stadio sperimentale, senza ancora dimostrare efficacia nel mondo reale.

🧩 Adaptive AI e regolamentazione: la corsa della tecnologia

Le autorità sanitarie stanno cercando di colmare il divario tra innovazione e regolamentazione.

La Food and Drug Administration (FDA) sta sviluppando linee guida per i dispositivi di “adaptive AI”, ovvero algoritmi che si aggiornano autonomamente dopo l’immissione sul mercato.

📖 Fonte: FDA – Artificial Intelligence/Machine Learning-Based Software as a Medical Device (SaMD) Action Plan, 2025

Questa evoluzione richiede nuovi standard di sicurezza, tracciabilità e controllo continuo sui software clinici autoadattivi.

👩⚕️ Formazione e integrazione: l’IA al servizio dell’intelligenza umana

L’IA deve diventare uno strumento di supporto, non un sostituto della competenza medica.

La formazione dei professionisti sanitari è cruciale per comprendere, controllare e interpretare i risultati generati dagli algoritmi.

Solo così l’intelligenza artificiale potrà restare al servizio dell’intelligenza umana, favorendo una collaborazione equilibrata tra tecnologia e giudizio clinico.

⚖️ Considerazioni etiche e sociali

L’introduzione dell’IA nella cardiologia non è solo una questione tecnologica, ma implica anche riflessioni profonde su etica, responsabilità e giustizia sociale.

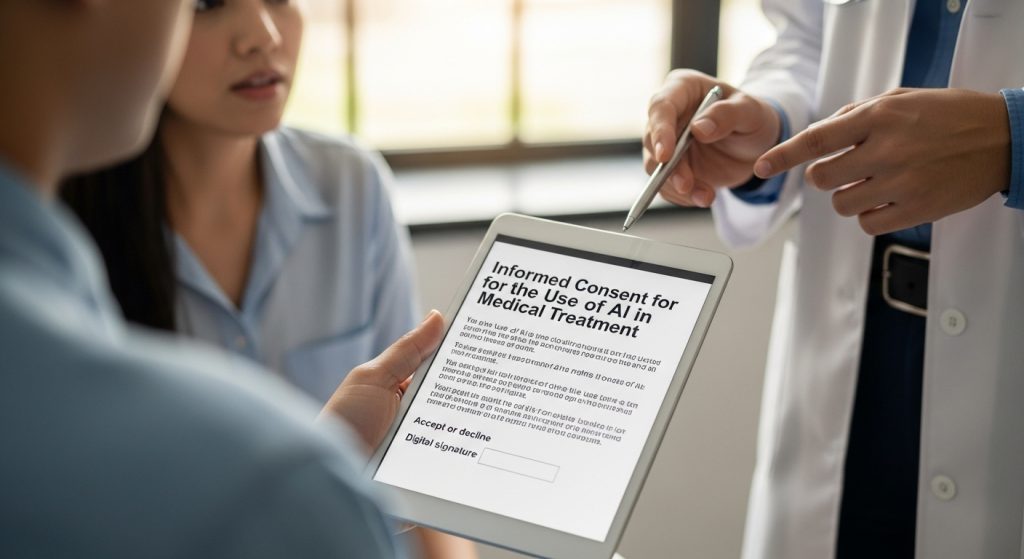

🫀 Autonomia e consenso informato: l’algoritmo entra in sala visita

Il consenso informato assume nuove complessità quando l’IA contribuisce alla diagnosi o al trattamento.

I pazienti devono sapere quando e come un algoritmo interviene nelle decisioni cliniche.

Negli ambienti d’urgenza, questa trasparenza diventa ancora più critica, poiché le decisioni rapide possono influenzare direttamente la prognosi.

⚖️ Responsabilità medico-legale: chi risponde quando l’algoritmo sbaglia?

Quando un sistema di IA produce un errore diagnostico, chi ne è responsabile?

Il medico, il produttore del software, o l’ospedale che l’ha adottato?

Le attuali normative considerano l’IA come strumento di supporto decisionale, mantenendo la responsabilità ultima in capo al professionista sanitario. Tuttavia, cresce l’esigenza di definire nuovi standard di responsabilità condivisa in caso di errori algoritmici.

🌍 Equità di accesso e digital divide: il rischio di una cardiologia a due velocità

Il bias algoritmico riduce l’accuratezza diagnostica fino al 17% nei pazienti appartenenti a minoranze etniche, mentre il 29% degli adulti in aree rurali resta escluso dai servizi basati su IA.

📖 Fonte: Electronic Health Records (EHR) in 2025 and Beyond: AI, Cloud, and Patient-Centric Care

Per evitare una cardiologia a due velocità, è necessario garantire equità di accesso, trasparenza dei dati e inclusività nei modelli di sviluppo.

📖 Altri riferimenti:

🔍 Trasparenza e diritto alla spiegazione

L’EU AI Act impone che i sistemi di IA siano tracciabili, spiegabili e non discriminatori.

📖 Fonti:

La trasparenza è una condizione essenziale per la fiducia e la sicurezza dei pazienti, specialmente in applicazioni cardiologiche ad alto rischio.

Il quadro normativo europeo

Entrato in vigore nell’agosto 2024, l’EU Artificial Intelligence Act è il primo framework giuridico estensivo al mondo dedicato all’IA.

📖 Fonti ufficiali:

L’AI Act classifica i sistemi di IA in base al livello di rischio, imponendo valutazioni rigorose, dataset di alta qualità, supervisione umana e monitoraggio post-commercializzazione.

📖 Testo completo: https://eur-lex.europa.eu/legal-content/IT/TXT/PDF/?uri=OJ:L_202401689